Anthropic社*が2026年4月に発表したAIモデルClaude Mythos(クロード・ミトス)は、非常に高いプログラミング・解析能力を持つが、サイバー攻撃に悪用されるリスクが極めて高いため一般公開は見送られている。という情報についてAI Geminiとのチャットを通して、OpenAIとAnthropicの企業理念、AIビジネスの現状そしてAIによるサイバー攻撃の高速化と防御側の課題 などについて考えてみる。

- ロゴ

Anthropic

OpenAI

Gemini

OpenAIとAnthropicについて

OpenAIとそこからスピンアウト(独立)したメンバーによって設立されたAnthropicは、どちらも現代のAI開発をリードするトップ企業ですが、その企業理念や開発アプローチには明確な違いがあります。

一言で言えば、「圧倒的な能力(汎用人工知能:AGI)の最速での実現」を目指すOpenAIに対し、Anthropicは「制御可能で、安全で、人間の価値観に誠実なAI(アライメント)の実現」を最優先に掲げています。

両者の理念や方向性の違いを、いくつかの軸に分けて解説します。

1. 設立の経緯と根本的な思想の違い

Anthropicは2021年、OpenAIの元研究幹部であったダリオ・アモデイ(Dario Amodei)氏とダニエラ・アモデイ(Daniela Amodei)氏の兄妹を中心としたグループによって設立されました。

- OpenAIの思想:能力と普及の最大化

元々は非営利団体としてスタートしましたが、AGI(人間の知能を超える人工知能)をどこよりも早く、強力な形で実現することに重きを置いています。そのため、莫大な計算資源(資金)を確保するために商業化へ舵を切り、現在は「利益上限付きの営利法人」を傘下に持つ構造になっています。

- Anthropicの思想:安全第一(セーフティ・バイ・デザイン)

創設者たちは、OpenAIが商業化を急ぐあまり、AIが暴走したり人間に危害を加えたりしないようにする「安全性(アライメント)の研究」を軽視し始めているのではないか、という強い危機感を抱いて離反しました。そのため、最初から「安全性そのものを製品の強みにする」という思想を持っています。

2. 企業形態の違い

理念を確実に実行するため、組織の法的な枠組みにも違いが見られます。

| 項目 | OpenAI | Anthropic |

| 主な企業形態 | 営利法人(非営利法人の管理下) | パブリック・ベネフィット・コーポレーション(PBC) |

| 特徴 | 商業的な成功と出資者へのリターンを考慮しつつ、AGI開発を目指す。 | 利益だけでなく、「社会的な利益(安全なAI開発)」を追求することが法的に義務付けられている。 |

Anthropicは「公益法人(PBC)」という形態をとっているため、仮に株主から「もっと安全性を無視して利益を上げろ」と圧力がかかっても、法的に「安全性を優先する」と言い切れる防壁を作っています。

3. 技術的アプローチ(理念の具現化)

この理念の違いは、彼らが開発するAI(ChatGPTとClaude)の設計思想にも色濃く反映されています。

- OpenAI:フロンティアの開拓と実用性

OpenAIは、まず「誰も到達していない圧倒的な能力」を示し、それを実用的なツールとして社会に実装していくアプローチです。

* アプローチ:多機能、マルチモーダル、プラグインや外部ツールとの連携など、実務でガンガン使える「有能なアシスタント」をスピーディに提供します。

- Anthropic:憲法AI(Constitutional AI)

Anthropicが開発した有名な手法が「Constitutional AI(憲法AI)」です。

* アプローチ: AIをトレーニングする際、人間が付きっきりで「これはダメ、あれはダメ」と教え込むのではなく、最初に「AIのための憲法(行動規範)」を明示的に与えます。AIはその憲法に基いて、自分自身の出力が適切かどうかを自ら評価・修正します。

* 結果: Claudeに見られるような、過度な偏見が少なく、有害なリクエストに対して「なぜ答えられないか」を誠実かつ客観的に説明する、「行儀が良く、人間の指示に誠実(Helpful, Honest, Harmless)」な性質が生まれています。

まとめ:進む方向の対比

現在の両社を例えるなら、以下のようなキャラクターの違いがあります。

- OpenAI: 誰も見たことがない超高性能なエンジンを開発し、世界をあっと言わせる「スピード重視のイノベーター」

- Anthropic: そのエンジンが暴走して事故を起こさないよう、ブレーキやシートベルトの技術を極限まで高めながら進化する「安全性・信頼性重視のエンジニア」

結果として、現在のClaudeシリーズのように「長文の文脈を正確に読み解く能力」や「倫理的に安定したコード・文章生成」においてAnthropicが非常に高い評価を受けるなど、アプローチの違いが良い意味で市場の健全な競争を生み出しています。

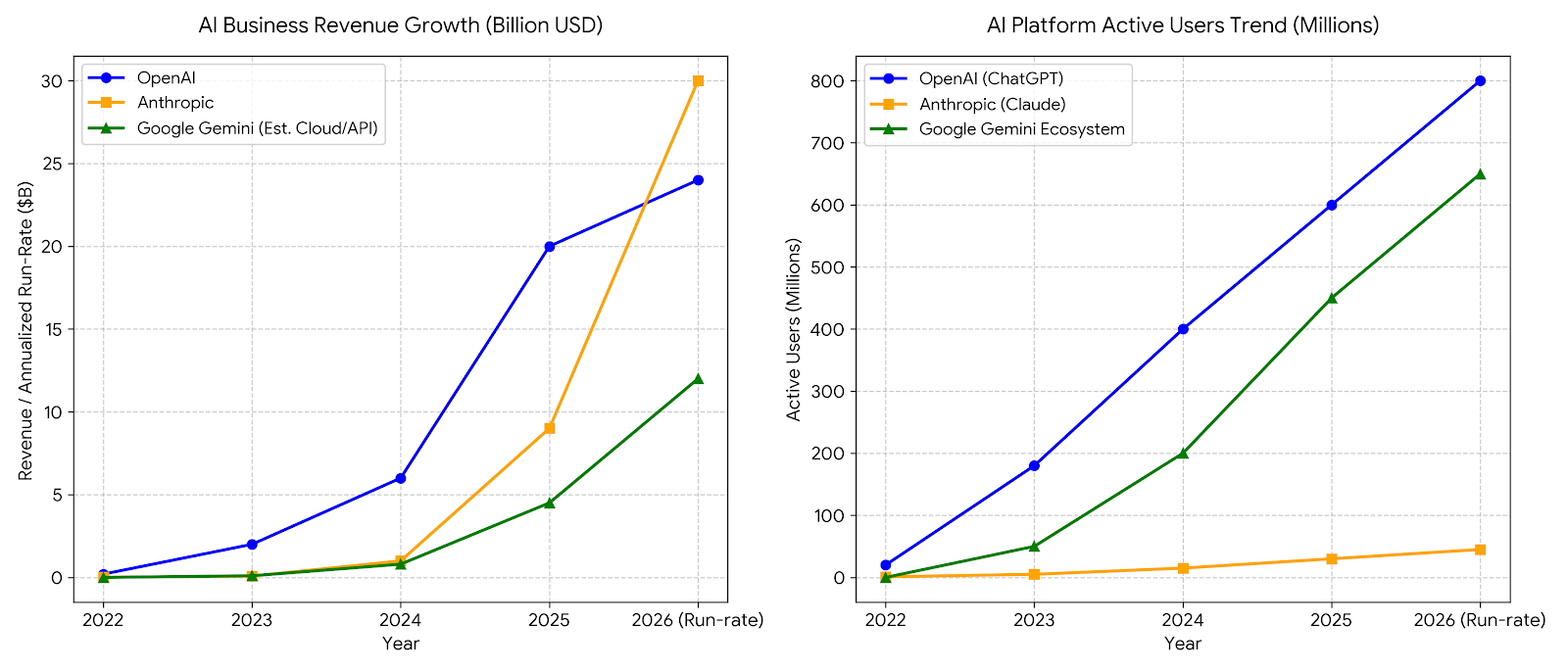

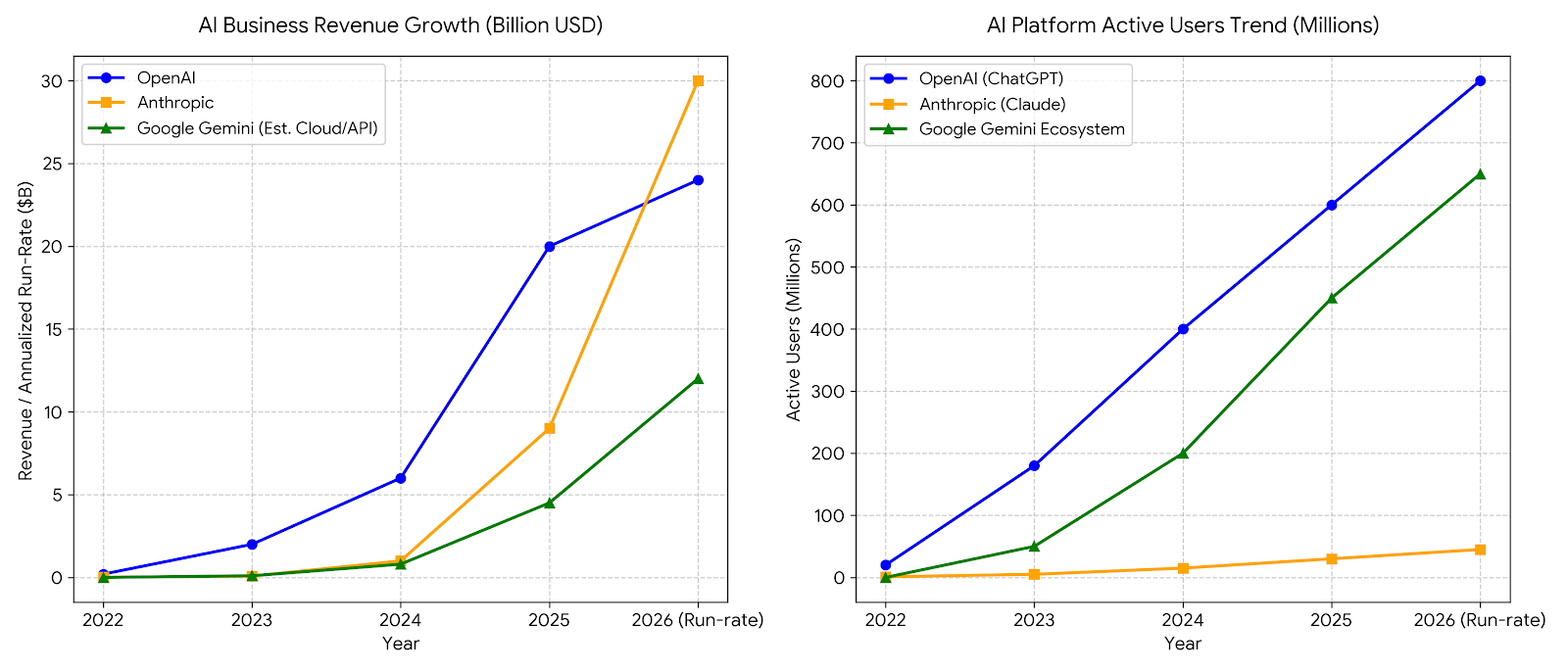

一般情報としてAIビジネスマーケットを紹介。

世界の主要AIブランド(OpenAI、Anthropic、Google Gemini)における過去5年間(2022年〜2026年現在まで)の売上高(年間実行レート:ARR)および利用者数の推移グラフを作成しました。

AI市場は非常に変化が激しく、特に直近の2026年に入ってから勢力図に大きな地殻変動が起きています。

AIビジネスの売上高と利用者数の推移グラフ

AIビジネスの売上高と利用者数の推移

「AIによるサイバー攻撃の高速化と防御側の課題」 についてGeminiとのチャットをソースとしてGeminiのツールNotebookLMで要約。

追加していただいたテキストに基づき、ソフトウェアの品質規格(ISO/IEC 25010など)に関する詳細を組み込んで、全体の要約を更新しました。

1. AIによるサイバー攻撃の高速化と防御側の課題

攻撃者はAIを使って未知のバグ(ゼロデイ脆弱性)の発見や攻撃コードの生成を超高速化しています。

一方、防御側もAIを導入して脆弱性の自動検知を進めていますが、AIによる「誤検知(根拠のない脆弱性レポート)」が大量発生し、オープンソースの現場がパンクするといった新たな問題も生じています。

2. 複雑化する脆弱性と「データと命令の境界」

Log4Shell*や画像データへの不正コード隠蔽(ステガノグラフィなど)のように、近年の重大な脆弱性は「ただのデータ」が、システムの親切すぎる仕様や古い設定によって「実行される命令」として解釈されてしまうことで発生します。

これを完璧に防ぐことは難しく、入り口でのデータ無害化や、実行を強制遮断する多層防御が必須となっています。

*Log4Shell : ログとして保管されたデータがプログラムコードとして実行されてしまう2021年に発生した歴史上最大級のセキュリティ事件。

3. AIによるプログラマー支援と模擬攻撃

人間のミスや熟練度不足を補うため、開発現場ではAIがコード執筆時にリアルタイムで安全な書き方を提案したり、プログラムの文脈を理解して深いバグを指摘したりするようになっています。

また、完成したシステムに対してAIが「ハッカーのフリ」をして数万通りの模擬攻撃(ペネトレーションテスト)を自動で行い、潜在的な穴を炙り出しています。

4. 工業化するソフトウェア品質と「ISO/IEC 25010」

ソフトウェア開発は現在、製造業と同様に厳格な基準によって品質が管理されています。その代表が国際規格「ISO/IEC 25010(SQuaREシリーズ)」であり、ソフトウェアの品質を以下の8つの特性で評価します。

・機能適合性(正しく動くか)

・性能効率性(無駄がないか)

・互換性(連携できるか)

・利用時の品質(使いやすいか)

・信頼性(安定しているか)

・セキュリティ(安全か)

・保守性(修正しやすいか)

・移植性(環境移行しやすいか)

経験の浅いプログラマーは「とりあえず動く(機能適合性)」だけで満足しがちですが、この規格は、セキュリティや保守性なども満たさなければ本当に高品質とは言えないことを示しています。

さらに、組織の開発能力を5段階で測る「CMMI」や、コードを変更するたびに自動でテストを行う「CI/CD」といった仕組みが導入されています。現在では、これらの厳しい品質基準やルールを学習したAIが24時間体制でコードの「自動検品」を行っており、ソフトウェアは職人の勘に頼らない高度な工業製品へと進化しています。